L'Era dell'IA Fisica: Un'Analisi Approfondita della Strategia Open Source, delle Architetture e dei Modelli Fondamentali di Mondo di NVIDIA

- Filippo-Maria Rotatori

- 2 dic 2025

- Tempo di lettura: 22 min

di F.M.R. 02/12/2025

Versione Breve

🌟 Sintesi Esecutiva: Il Salto verso l'IA Fisica

L'Era dell'IA Fisica: Una Narrazione Strategica

Siamo di fronte a un cambio di paradigma fondamentale. Se l'ultimo decennio è stato definito dall'IA Digitale—software capaci di scrivere, programmare e creare immagini—la nuova frontiera tracciata da NVIDIA alla conferenza NeurIPS è quella dell'IA Fisica. Non si tratta più solo di generare pixel o testo, ma di generare azioni che hanno conseguenze reali in un mondo governato da leggi fisiche immutabili.

Le immagini appartengono ai legittimi proprietari. (sopra : Nvidia)

Il Cuore del Problema: La Fisica non perdona La sfida centrale evidenziata nel rapporto è che, a differenza di un chatbot che può "allucinare" una risposta senza danni fisici, un robot o un'auto autonoma non possono permettersi errori. Per risolvere questo problema, NVIDIA ha teorizzato un'architettura basata su "Tre Computer". Il flusso inizia con un supercomputer per l'addestramento massivo, passa attraverso un "computer di simulazione" (Omniverse) dove i robot vivono milioni di vite in parallelo in una "realtà sintetica" fisicamente accurata, e termina nel "computer di runtime", il cervello a bordo del robot che esegue le azioni in tempo reale. In questo ecosistema, la simulazione non è un videogioco, ma la fonte primaria di verità e apprendimento.

Il Cervello della Nuova IA: Cosmos e il Ragionamento Al centro di questa rivoluzione c'è NVIDIA Cosmos, una piattaforma di modelli fondamentali (World Foundation Models). A differenza dei generatori di video artistici, i modelli Cosmos sono costruiti per capire la fisica: prevedono come gli oggetti cadono, rimbalzano o si rompono. Ma la vera innovazione risiede nell'introduzione di una capacità cognitiva duale, ispirata al cervello umano. Sia per le auto (con Alpamayo-R1) che per i robot umanoidi (con Progetto GR00T), NVIDIA ha implementato una distinzione tra "Sistema 1" e "Sistema 2". Il "Sistema 1" è l'esecutore: gestisce i riflessi veloci e l'equilibrio (come camminare senza cadere). Il "Sistema 2" è il pensatore: un modello che osserva la scena, ragiona sulle cause e sugli effetti (ad esempio, "vedo ghiaccio, quindi devo rallentare") e pianifica le azioni. Questo approccio risolve la fragilità dei vecchi modelli che si limitavano a imitare ciecamente le azioni umane senza capirne il contesto.

Le immagini appartengono ai legittimi proprietari. (sopra : Nvidia)

La Strategia Open Source: Un Fossato Difensivo Forse l'aspetto più sorprendente è la decisione di NVIDIA di rendere open source questi modelli avanzati, inclusi i pesi di Alpamayo e il "Cosmos Cookbook". Non è un atto di pura beneficenza, ma una mossa strategica calcolata. Rendendo accessibile il software più avanzato per la robotica, NVIDIA sta di fatto standardizzando l'intero settore sulla propria architettura. Le startup e i ricercatori useranno questi modelli gratuiti, ma per addestrarli ed eseguirli efficacemente avranno bisogno dell'hardware NVIDIA (GPU H100, chip Thor, Isaac Lab). È una strategia classica: mercificare il software per accrescere il valore indispensabile dell'hardware sottostante.

In conclusione, l'annuncio segna il momento in cui l'IA scende dal cloud per "incarnarsi" in corpi metallici, dotata per la prima volta non solo di riflessi, ma della capacità di ragionare sul mondo che la circonda.

Le immagini appartengono ai legittimi proprietari. (sopra : Nvidia)

Riassunto Schematico

1. L'Architettura dei "Tre Computer"

Per gestire la complessità dell'IA fisica, NVIDIA propone un flusso di lavoro diviso in tre fasi distinte:

Il Computer di Addestramento (AI Supercomputer): Cluster massivi (GPU H100/Blackwell) per addestrare modelli fondamentali su scala internet (video, dati fisici).

Il Computer di Simulazione (Omniverse): Il luogo dove i robot "nascono e crescono". Non è solo grafica, ma simulazione fisica accurata (equazioni differenziali, attrito, massa) per generare dati sintetici ("Realtà Sintetica") e validare i sistemi prima del mondo reale.

Il Computer di Runtime (Inferenza all'Edge): Il "cervello" a bordo del robot o veicolo (es. Jetson Thor), ottimizzato per bassa latenza e consumi ridotti per eseguire le azioni in tempo reale.

2. NVIDIA Cosmos: I Modelli Fondamentali del Mondo (WFM)

Cosmos è una piattaforma open source di modelli progettati per comprendere e prevedere stati fisici, non solo per plausibilità visiva.

Approccio Ibrido:

Cosmos-Diffusion: Generazione ad alta fedeltà ("Motori di Immaginazione") per creare scenari di addestramento.

Cosmos-Autoregressive: Previsione del futuro (cosa succede dopo?), essenziale per la pianificazione.

Innovazione nei Token: Uso di tokenizzatori discreti (per il ragionamento logico) e continui (per la fluidità visiva).

Cosmos Reason (Il Critico): Un modello "Sistema 2" che verifica se una simulazione ha senso fisico (es. "una tazza non può fluttuare"), agendo da guardrail contro le "allucinazioni" fisiche.

3. Alpamayo-R1: La Rivoluzione nella Guida Autonoma

Un modello Vision-Language-Action (VLA) open source che supera i limiti del semplice apprendimento per imitazione ("Monkey see, monkey do").

Catena di Causalità (Chain of Causation): Il modello non sterza e basta; prima "pensa". Genera una spiegazione linguistica della scena (es. "Vedo ghiaccio -> Devo rallentare") e poi agisce. Questo riduce la "confusione causale".

Risultati: Riduzione del 35% delle uscite di strada e miglioramento del 45% nella qualità del ragionamento rispetto ai modelli tradizionali.

4. Progetto GR00T: Cervello per Robot Umanoidi

GR00T applica un'architettura cognitiva Duale (Sistema 1 vs Sistema 2), ispirata al pensiero umano:

Sistema 2 (Il Pensatore): Un VLM lento e deliberato. Pianifica strategie di alto livello (es. "Andare verso la scatola").

Sistema 1 (L'Esecutore): Una policy veloce e reattiva. Gestisce l'equilibrio e i movimenti precisi dei giunti a frequenza elevata.

Piramide dei Dati: L'addestramento avviene su tre livelli: conoscenza ampia (video web) -> realtà sintetica (Omniverse/Isaac Lab) -> dati reali teleoperati (alta qualità).

5. Strategia Open Source e Sviluppo

NVIDIA sta democratizzando l'accesso a queste tecnologie per creare uno standard industriale.

Cosmos Cookbook: "Ricette" pronte all'uso per sviluppatori per gestire dati sintetici e valutare policy.

Licenze Aperte: Codice sorgente (Apache 2.0) e pesi dei modelli (NVIDIA Open Model License) sono disponibili anche per uso commerciale.

Obiettivo Strategico: Rendendo il software (modelli avanzati) aperto e accessibile, NVIDIA incentiva l'intero ecosistema a costruire su piattaforme che richiedono il suo hardware (GPU H100, chip Thor), consolidando il suo predominio nell'era della robotica.

Approfondimento

Introduzione

La convergenza tra l'intelligenza artificiale generativa e il mondo fisico segna un punto di flesso definitivo nella traiettoria dell'evoluzione tecnologica. Per gran parte dell'ultimo decennio, la rivoluzione dell'IA è rimasta confinata prevalentemente nel dominio digitale—processando testo, generando immagini e sintetizzando codice. Tuttavia, gli annunci effettuati da NVIDIA in occasione della conferenza NeurIPS, specificamente riguardanti il rilascio open source di asset critici per la "Physical AI" (IA Fisica), segnalano l'inizio di una nuova fase industriale: il dispiegamento di capacità di ragionamento di "Sistema 2" all'interno di agenti incarnati come robot umanoidi e veicoli a guida autonoma.1

Questo rapporto fornisce un'analisi tecnica e strategica esaustiva della svolta di NVIDIA verso l'IA Fisica, un dominio in cui l'intelligenza digitale deve confrontarsi con le leggi immutabili della fisica, vincoli di sicurezza critici e l'imprevedibilità caotica del mondo reale. Al centro di questa analisi si trova l'introduzione di NVIDIA Cosmos, una piattaforma di World Foundation Models (WFMs) progettati per simulare e prevedere risultati fisici con una fedeltà senza precedenti.3 Esaminiamo le innovazioni architettoniche di Alpamayo-R1, il primo modello Vision-Language-Action (VLA) open source del settore dotato di capacità di ragionamento per la guida autonoma 5, e del Progetto GR00T, un modello fondamentale per umanoidi che introduce un'architettura cognitiva "duale" che imita il pensiero umano veloce e lento.7

Inoltre, esploriamo la democratizzazione di queste tecnologie attraverso il "Cosmos Cookbook" e il rilascio di pesi aperti su piattaforme come Hugging Face e GitHub.9 Analizzando oltre 70 paper di ricerca e workshop presentati a NeurIPS 2, inclusi progressi negli operatori neurali e meccanismi di attenzione sferica 11, questo rapporto elucida come NVIDIA stia orchestrando uno spostamento dai metodi puramente guidati dai dati (data-driven) a approcci guidati da bias induttivi che rispettano le leggi fisiche. Le implicazioni di questi rilasci si estendono oltre l'accademia; rappresentano una ristrutturazione fondamentale delle pipeline di sviluppo robotico e automobilistico, spostandosi dal controllo basato su euristiche all'apprendimento end-to-end fondato su simulazioni fisicamente consapevoli.

1. Il Cambio di Paradigma: Dall'IA Digitale all'IA Fisica

1.1 Definire l'IA Fisica

L'IA Fisica rappresenta quella classe di sistemi di intelligenza artificiale che interagiscono direttamente con il mondo materiale. A differenza dei Large Language Models (LLM) che producono testo basandosi su correlazioni statistiche in dati digitali, i modelli di IA Fisica devono produrre azioni—coppie motrici, angoli di sterzata o traiettorie di manipolatori—che risultano in cambiamenti di stato in un ambiente fisico.13 Questo introduce un livello di complessità assente nell'IA digitale: il costo dell'errore non è semplicemente una frase "allucinata", ma potenziali danni fisici, rischi per la sicurezza o fallimenti catastrofici in contesti industriali.

La transizione verso l'IA Fisica richiede un ripensamento fondamentale dell'architettura dei modelli. I "Gemelli Digitali" (Digital Twins) e i "Modelli di Mondo" (World Models) diventano i campi di addestramento primari, poiché la raccolta di dati nel mondo reale è spesso troppo lenta, costosa o pericolosa.13 La strategia di NVIDIA, svelata a NeurIPS, si basa sul concetto che la simulazione è il motore dell'IA Fisica. Creando mondi virtuali fisicamente accurati (Omniverse), gli sviluppatori possono generare infiniti dati sintetici per addestrare gli agenti prima che essi abitino un corpo fisico.15

Le scienze fisiche sono definite in modo inclusivo in questo contesto, spaziando dalla fisica all'astronomia, dalla chimica alla scienza dei materiali.11 L'integrazione del machine learning in questi campi non riguarda meramente l'ottimizzazione; si tratta di "PS for ML" (Scienze Fisiche per il Machine Learning)—utilizzare intuizioni fisiche per vincolare e guidare il processo di apprendimento dei modelli AI. Questo flusso bidirezionale è critico: i simulatori stimolano progressi nella programmazione differenziabile, mentre i modelli ML forniscono modelli surrogati che accelerano le simulazioni di ordini di grandezza.11

1.2 L'Architettura dei "Tre Computer"

L'ecosistema di NVIDIA per l'IA Fisica è predicato su un flusso di lavoro a "Tre Computer", un quadro strutturale che garantisce scalabilità e sicurezza. Questa architettura riconosce che i requisiti computazionali per apprendere un compito sono vastamente diversi da quelli per simulare l'ambiente, che sono a loro volta diversi da quelli per eseguire il compito in tempo reale.

1.2.1 Il Computer di Addestramento (AI Supercomputer)

Questo livello utilizza cluster di GPU NVIDIA H100 e Blackwell per addestrare massicci modelli fondamentali come Cosmos e GR00T su dati a scala internet.13 Il carico computazionale qui è caratterizzato da dimensioni di batch enormi e orizzonti di addestramento lunghi. Per esempio, l'addestramento dei modelli Cosmos ha coinvolto oltre 10.000 GPU H100 processando 20 milioni di ore di video.16 L'obiettivo di questo computer è distillare la vasta complessità del mondo visivo e fisico in una rappresentazione latente compressa che possa essere utilizzata per la generazione e la previsione.

1.2.2 Il Computer di Simulazione (Omniverse)

Il "Computer di Simulazione" è dove il robot nasce e cresce. È un ambiente virtuale fisicamente conforme dove robot e veicoli autonomi (AV) vivono milioni di vite in parallelo.

Ruolo di Omniverse: Fornisce la "Verità Fondamentale" (Ground Truth) fisica. A differenza di un motore per videogiochi che approssima la fisica per l'effetto visivo, Omniverse (alimentato dal motore fisico Newton) risolve equazioni differenziali per garantire collisioni, attriti e dinamiche di massa accurate.7

Generazione di Dati Sintetici: Questo livello genera lo "Strato Intermedio" della piramide dei dati di addestramento—miliardi di frame di scenari sintetici (ad esempio, un robot che scivola sull'olio, un'auto che affronta un bagliore accecante) che sono rari nel mondo reale ma critici per la robustezza.15

Software-in-the-Loop (SIL): Il "Mega" Omniverse Blueprint espande questo concetto ai gemelli digitali a scala di fabbrica, permettendo la simulazione di intere linee di produzione. Siemens e Foxconn sono citati come primi adottatori, utilizzando questo sistema per validare flussi di lavoro robotici prima del dispiegamento fisico.13

1.2.3 Il Computer di Runtime (Inferenza all'Edge)

Questo è il cervello a bordo (es. Jetson Thor, DRIVE AGX) che esegue la policy in tempo reale.

Vincoli: A differenza del computer di addestramento, il computer di runtime è vincolato dalla potenza (watt), limiti termici e requisiti di latenza.

Esecuzione: Gestisce il ciclo sensomotorio immediato—prendendo dati grezzi dai sensori (telecamera, lidar), processandoli attraverso la policy di "Sistema 1" (discussa successivamente) e producendo comandi motori. Gli annunci enfatizzano il dispiegamento di modelli come Alpamayo-R1 su questo hardware edge con latenze basse fino a 99ms.6

2. NVIDIA Cosmos: La Piattaforma dei World Foundation Models

Al cuore del rilascio open source di NVIDIA si trova NVIDIA Cosmos, una suite di World Foundation Models (WFMs) progettati per comprendere, prevedere e generare stati fisici. A differenza dei modelli di generazione video addestrati esclusivamente per la plausibilità visiva (come Sora o Runway), i modelli Cosmos sono addestrati per aderire alla coerenza fisica, rendendoli adatti per la simulazione affidabile e l'addestramento dei robot.3

2.1 Architettura Cosmos: Diffusione vs Autoregressiva

La famiglia Cosmos impiega un approccio ibrido, offrendo sia architetture basate sulla diffusione che autoregressive per affrontare diversi aspetti della modellazione del mondo. Questo riconosce che compiti diversi a valle richiedono formulazioni matematiche differenti.

2.1.1 Cosmos-Diffusion (7B e 14B)

I modelli a diffusione (es. Cosmos-1.0-Diffusion-7B-Text2World e Video2World) sono focalizzati primariamente sulla generazione ad alta fedeltà e sul denoising nello spazio latente.

Meccanismo: Questi modelli utilizzano un backbone Diffusion Transformer (DiT). Incorporano livelli interleaved di self-attention, cross-attention e feedforward. Crucialmente, viene applicata una normalizzazione adattiva dei livelli per incorporare informazioni temporali, permettendo al modello di comprendere la progressione temporale nelle scene fisiche.16

Condizionamento: I livelli di cross-attention permettono al modello di condizionarsi su testo in input o altre modalità durante tutto il processo di denoising. Questo permette un controllo preciso sulla scena generata (es. "Aggiungi pioggia battente a questa scena stradale").12

Caso d'Uso: Sono ideali per compiti "Text2World" dove uno sviluppatore descrive uno scenario e il modello genera una clip video fisicamente plausibile per addestrare sistemi di percezione. Servono come "Motori di Immaginazione" per la simulazione.18

Intensità delle Risorse: Il modello 14B è computazionalmente esigente. Quando si scaricano componenti come guardrails e upsampler dei prompt, può richiedere >80GB di memoria GPU per la piena precisione, rendendo di fatto necessario hardware di classe H100 per un'inferenza efficiente.16

2.1.2 Cosmos-Autoregressive (4B, 5B, 12B, 13B)

I modelli autoregressivi sono ottimizzati per prevedere stati futuri basandosi sul contesto passato, una capacità critica per l'apprendimento per rinforzo basato su modelli (Model-Based Reinforcement Learning).

Meccanismo: Questi modelli trattano i frame video come sequenze di token, in modo simile a come gli LLM trattano il testo. Il modello Cosmos-1.0-Autoregressive-12B genera sequenze video fisicamente consapevoli da input video semplici, effettivamente "immaginando" cosa accadrà dopo.18

Scalabilità: Con un conteggio dei parametri che varia da 4B a 13B, questi modelli offrono un compromesso tra velocità di inferenza e accuratezza dell'orizzonte di previsione. Le varianti Video2World possono prendere un video seme ed estenderlo, simulando l'esito delle azioni di un agente.18

Coerenza Fisica: Essendo autoregressivi, sono più adatti a mantenere la coerenza causale su orizzonti più lunghi rispetto ai modelli di pura diffusione, che a volte possono "sognare" transizioni fisicamente impossibili.

2.2 Strategie di Tokenizzazione: Discreta vs Continua

Un'innovazione chiave in Cosmos è l'uso di tokenizzatori video specializzati, riconoscendo che i pixel grezzi sono un mezzo inefficiente per il ragionamento fisico.

Tipo di Tokenizzatore | Compressione Spaziale | Compressione Temporale | Contesto Temporale | Modello Associato | Vantaggio Chiave |

Discreto (DV8x16x16) | 16x16 | 8x | 49 Frame | Autoregressivo | Permette il ragionamento categorico e logico nello spazio latente. |

Continuo (CV8x8x8) | 8x8 | 8x | 121 Frame | Diffusione | Mantiene gradienti fluidi per texture e illuminazione ad alta fedeltà. |

Analisi: Il tokenizzatore discreto comprime il video in un "vocabolario" di codici, permettendo al modello di eseguire ragionamenti categorici (es. "stato oggetto = caduta"). Il tokenizzatore continuo, invece, previene l'errore di quantizzazione che può rendere il video generato a blocchi o tremolante, essenziale per l'addestramento della visione artificiale.18

2.3 Cosmos Reason: Il Critico di "Sistema 2"

Forse l'aggiunta più significativa è Cosmos Reason. Questo non è solo un generatore, ma un critico e un ragionatore.

Funzione: Agisce come un Vision-Language Model (VLM) che valuta l'output della simulazione o il piano del robot. Fornisce un ragionamento "Chain-of-Thought" (CoT) per verificare se uno scenario generato ha senso fisico (es. "La tazza non può fluttuare a mezz'aria; la gravità deve agire su di essa").3

Guardrails: Cosmos Reason è integrato nella pipeline di generazione dati per filtrare la fisica "allucinata". Può anche agire come un generatore di didascalie (captioner), creando descrizioni dettagliate dei dati video per migliorare l'addestramento di altri modelli.3

Prestazioni: Il fine-tuning su compiti di IA Fisica ha potenziato le prestazioni del modello base di Cosmos Reason di oltre il 10%, con l'apprendimento per rinforzo che ha aggiunto un ulteriore guadagno del 5%. Raggiunge un punteggio medio di 65.7 attraverso i benchmark chiave per robotica e AV.19

2.4 Dati di Addestramento e Scala

Il corpus di addestramento per Cosmos è immenso, comprendendo 20 milioni di ore di video, curati in 100 milioni di clip di alta qualità.16

Pipeline di Curatela: NVIDIA ha sviluppato una pipeline specifica che coinvolge rilevamento delle inquadrature, filtraggio del movimento e valutazione della qualità visiva per rimuovere filmati statici o di bassa qualità. La deduplicazione semantica assicura che il modello apprenda una gamma diversificata di interazioni fisiche piuttosto che memorizzare pattern ripetitivi.16

Infrastruttura di Calcolo: L'addestramento ha utilizzato oltre 10.000 GPU NVIDIA H100. La pipeline include transcodifica e tokenizzazione accelerate via hardware, raggiungendo un "throughput di addestramento senza precedenti".16

2.5 Il "Cosmos Cookbook" e l'Ecosistema per Sviluppatori

Per democratizzare l'accesso, NVIDIA ha rilasciato il Cosmos Cookbook, una raccolta di "ricette" per il post-training e il dispiegamento di questi modelli. Questa è una mossa strategica per vincolare gli sviluppatori all'ecosistema NVIDIA fornendo il "know-how" per compiti complessi.2

Curatela dei Dati: Utilizzare Cosmos Reason per etichettare automaticamente massicci dataset video, riducendo la dipendenza dagli etichettatori umani.

Generazione di Dati Sintetici: Creare "gemelli digitali" di ambienti caotici (es. pioggia, neve, abbagliamento) per irrobustire i modelli di percezione. Il cookbook include ricette per "Cosmos Transfer", che può prendere una mappa di segmentazione da un simulatore e "dipingerla" con texture fotorealistiche.4

Valutazione delle Policy: Utilizzare Cosmos Predict per prevedere l'esito dell'azione pianificata da un robot senza richiedere una prova nel mondo reale.9

3. Guida Autonoma: La Rivoluzione di Alpamayo-R1

Mentre Cosmos fornisce le fondamenta, Alpamayo-R1 (AR1) rappresenta l'applicazione specifica di questi principi ai veicoli a guida autonoma (AV). Rilasciato come modello open source su GitHub e Hugging Face, AR1 punta al Livello 4 di autonomia—piena autonomia all'interno di domini operativi definiti.5

3.1 Il Fallimento del Puro Imitation Learning

I modelli tradizionali di guida end-to-end spesso si basano sull'imitation learning—imitare i guidatori umani. Tuttavia, questi modelli sono "fragili" negli scenari a coda lunga (long-tail).

Il Problema: In situazioni critiche per la sicurezza dove la supervisione è scarsa (es. un pedone parcheggiato in doppia fila su una pista ciclabile mentre una squadra di costruzione segnala il traffico), chi apprende per imitazione fallisce perché manca di comprensione causale. Spesso confondono correlazione (le auto si fermano quando i semafori sono rossi) con causalità (le auto si fermano perché il traffico trasversale ha la precedenza).6

La Conseguenza: Questo porta a "confusione causale" e comportamenti insicuri quando il modello incontra una situazione che assomiglia visivamente a uno scenario noto ma ha dinamiche causali sottostanti diverse.

3.2 Architettura VLA con Catena di Causalità

Alpamayo-R1 è un modello Vision-Language-Action (VLA). Non mappa semplicemente pixel in comandi di sterzata; genera una traccia di ragionamento intermedia.

Catena di Causalità (Chain of Causation - CoC): AR1 genera una spiegazione linguistica della scena prima o mentre pianifica la traiettoria.

Esempio di Traccia: "Osservazione: Vedo un pedone che scende dal marciapiede 20 metri avanti. Contesto: La superficie stradale appare ghiacciata a causa del riflesso. Ragionamento: Una frenata improvvisa potrebbe causare uno slittamento. Decisione di Azione: Decelerare dolcemente immediatamente e prepararsi a sterzare a sinistra se necessario.".6

Design Modulare: L'architettura combina:

Vision Encoder: Processa osservazioni multi-camera e multi-timestep.

Backbone Cosmos-Reason: Il motore centrale di "Sistema 2" che esegue il ragionamento causale.

Flow-Matching Decoder: Un decoder di azioni basato sulla diffusione che genera traiettorie continue e cinematicamente fattibili (piani d'azione) che si allineano con il ragionamento linguistico.6

3.3 Metriche di Prestazione e Validazione

Secondo i paper di ricerca NVIDIA rilasciati a NeurIPS:

Accuratezza di Pianificazione: AR1 mostra un miglioramento del 12% nell'accuratezza di pianificazione rispetto alle baseline di sola traiettoria in casi difficili e a coda lunga.2

Sicurezza: Dimostra una riduzione del 35% nei tassi di fuoriuscita di strada e una riduzione del 25% nei tassi di quasi-incidente in simulazioni a ciclo chiuso.2

Qualità del Ragionamento: Il post-training con Apprendimento per Rinforzo (RL) ha migliorato la qualità del ragionamento del modello del 45% (misurato da un modello critico più grande) e migliorato la coerenza tra ragionamento e azione del 37%.6

Latenza: Nonostante la pesante componente di ragionamento, il modello è ottimizzato per prestazioni in tempo reale, raggiungendo una latenza end-to-end di 99ms, sufficiente per la guida urbana in velocità.6

3.4 AlpaSim e Dataset Aperti

Per supportare la comunità, NVIDIA ha reso open source AlpaSim, un framework di simulazione specificamente per valutare modelli AV basati sul ragionamento.

Dataset Chain of Causation: Hanno anche rilasciato un sottoinsieme del dataset Chain of Causation (CoC), che contiene tracce di ragionamento etichettate automaticamente e fondate su decisioni di guida. Questo dataset è stato costruito utilizzando una pipeline ibrida di annotazione umana-in-the-loop e auto-etichettatura con VLM all'avanguardia.6

Impatto: Questo affronta una lacuna critica di dati nella comunità accademica, che mancava di dataset di alta qualità che collegassero la percezione visiva al ragionamento causale di alto livello, abilitando una ricerca più ampia in sistemi AV interpretabili.

4. Robotica Umanoide e Generalista: Progetto GR00T

I principi applicati alle auto in Alpamayo sono applicati ai robot umanoidi nel Progetto GR00T (Generalist Robot 00 Technology). Gli annunci di NeurIPS hanno dettagliato l'architettura di GR00T N1 e dell'aggiornato N1.5.

4.1 L'Architettura Cognitiva Duale (Dual-System)

GR00T N1 introduce un'architettura "Sistema 1 vs Sistema 2" ispirata biologicamente, implementando efficacemente il quadro cognitivo di Daniel Kahneman per la robotica.7

4.1.1 Sistema 2: Il Pensatore (The Thinker)

Natura: Pensiero lento, deliberato, metodico.

Componente: Un Vision-Language Model (VLM) pre-addestrato, specificamente una versione dell'architettura Cosmos Reason o Eagle-2.

Funzione: Esegue a una frequenza inferiore (es. 10Hz). Processa immagini e istruzioni linguistiche (es. "Riordina il soggiorno"). Ragiona sull'ambiente ("Il giocattolo è sul pavimento"), scompone l'obiettivo di alto livello in un piano ("Naviga verso il giocattolo -> Afferra il giocattolo -> Naviga verso la scatola -> Lascia il giocattolo") e produce un piano di alto livello.23

4.1.2 Sistema 1: L'Esecutore (The Doer)

Natura: Pensiero veloce, riflessivo, intuitivo.

Componente: Una policy Diffusion Transformer (DiT).

Funzione: Esegue ad alta frequenza (es. 120Hz). Prende il piano di alto livello dal Sistema 2 e lo traduce in comandi motori precisi e continui (angoli di giunto, coppie). Gestisce la fisica immediata dell'equilibrio, della generazione dell'andatura e della stabilità della presa.23

4.1.3 Integrazione Fortemente Accoppiata

L'innovazione risiede nell'accoppiamento stretto di questi due sistemi. Il DiT (Sistema 1) esegue costantemente cross-attention sull'output del VLM (Sistema 2).

Beneficio: Questo assicura che le azioni fisiche del robot siano perfettamente allineate con la sua comprensione semantica. Se il Sistema 2 rileva "Questo oggetto è un uovo fragile", il Sistema 1 aggiusta automaticamente il suo controllo di impedenza per applicare una forza minima, anche se la primitiva di movimento "afferra" è generica.23

4.2 La Piramide dei Dati

Addestrare un umanoide generalista richiede una massiccia diversità di dati, che NVIDIA struttura come una piramide 23:

Strato Base (Conoscenza Ampia): Dati video a scala internet (YouTube, ecc.) processati da tecnologie come FLARE per insegnare al modello una comprensione ampia della cinematica umana e delle affordance degli oggetti.

Strato Intermedio (Realtà Sintetica): Miliardi di frame generati in Isaac Lab e Omniverse, utilizzando il motore fisico Newton. Questo strato insegna al robot la locomozione robusta e il recupero dalle cadute in un ambiente sicuro. L'Isaac GR00T Blueprint permette agli sviluppatori di generare quantità esponenzialmente grandi di dati di movimento sintetici.17

Strato Apice (Grounding nel Mondo Reale): Un dataset più piccolo e di alta qualità di dimostrazioni teleoperate (es. da 1X o Agility Robotics) per fare fine-tuning del modello per le dinamiche hardware specifiche. NVIDIA ha generato con successo 780.000 traiettorie sintetiche (equivalenti a 6.500 ore di dati umani) in sole 11 ore per aumentare questo strato.17

4.3 Supporto Cross-Embodiment

Il rilascio di GR00T N1.5 enfatizza il cross-embodiment. Utilizzando "Embodiment Tags" (Tag di Incarnazione), lo stesso modello fondamentale può controllare diversi fattori di forma robotici.

Meccanismo: L'architettura utilizza encoder e decoder specifici per l'incarnazione (piccoli MLP) per tradurre dati dei sensori e comandi motori per diverse parti del corpo.

Incarnazioni Supportate: Il rilascio include supporto per robot a braccio singolo (EmbodimentTag.OXE_DROID) e umanoidi con pinze (EmbodimentTag.AGIBOT_GENIE1).24

Integrazione DreamGen: GR00T N1.5 incorpora traiettorie neurali sintetiche generate via DreamGen, abilitando la generalizzazione a comportamenti nuovi oltre a quelli presenti nei dati di teleoperazione.24

5. Sviluppo Simulation-First: Omniverse, Isaac e "The Blueprint"

La "salsa segreta" che abilita sia Alpamayo che GR00T è l'infrastruttura di simulazione. La filosofia di NVIDIA è che il mondo fisico è troppo lento per un apprendimento efficiente; pertanto, l'apprendimento deve avvenire nel gemello digitale.

5.1 Il "Mega" Omniverse Blueprint

NVIDIA ha annunciato il "Mega" Omniverse Blueprint, un'architettura di riferimento per costruire gemelli digitali a scala di fabbrica.13

Scala: Questo espande Omniverse dalla simulazione di singoli robot alla simulazione di interi impianti (es. la fabbrica di 242.000 piedi quadrati di Foxconn).

Software-in-the-Loop (SIL): Il "cervello" del robot (software) viene eseguito all'interno del gemello digitale, ricevendo dati sintetici dai sensori e producendo azioni. Questo ciclo permette la validazione di milioni di casi limite (es. interruzione di corrente, percorsi ostruiti) prima del dispiegamento, risparmiando rischi e costi enormi.15

5.2 Strumenti per la Generazione di Dati Sintetici

NVIDIA ha rilasciato diversi strumenti specifici per migliorare la generazione di dati sintetici, riconoscendo che "i dati sono il nuovo codice".

LidarGen: Un modello generativo per creare nuvole di punti Lidar realistiche. Questo è cruciale per l'addestramento AV, poiché raccogliere dati Lidar reali per ogni possibile scenario di incidente è impossibile.2

Omniverse NuRec Fixer: Utilizza l'IA per riparare artefatti nelle scene 3D ricostruite neuralmente. Quando un mondo 3D viene ricostruito da video 2D (usando NeRF o Gaussian Splatting), spesso contiene buchi o artefatti. Questo strumento li corregge, assicurando che l'ambiente di simulazione sia geometricamente accurato.2

NeMo Gym: Una libreria open source per ambienti di Apprendimento per Rinforzo (RL). Permette agli sviluppatori di configurare facilmente compiti RL (es. "prendi e posiziona", "riorientamento in mano") e addestrare agenti usando l'ottimizzazione della policy prossimale (PPO). È personalizzato per l'addestramento di modelli linguistici, colmando il divario tra RL e LLM.2

6. Frontiere Teoriche e Pubblicazioni di Ricerca (Analisi dei Paper)

Gli annunci di NeurIPS sono stati supportati da una pletora di paper tecnici che offrono uno sguardo sulla "prossima" generazione di modelli. L'analisi di questi documenti rivela l'impegno di NVIDIA nel fondere metodi data-driven con bias induttivi fisici.

6.1 "ThinkAct" e la Pianificazione Latente Visiva

Il paper ThinkAct: Vision-Language-Action Reasoning via Reinforced Visual Latent Planning 12 suggerisce uno spostamento verso agenti che "immaginano" l'esito visivo delle loro azioni prima di impegnarsi in esse. Questo si allinea con la capacità di Cosmos Predict, rafforzando la tendenza del Model-Based Reinforcement Learning (MBRL) in cui l'agente apprende un modello del mondo per pianificare.

6.2 Operatori Neurali sulla Sfera

Il paper Spherical Fourier Neural Operators: Learning Stable Dynamics on the Sphere 12 è critico per le simulazioni su scala globale (es. meteo per la navigazione autonoma o droni). Dimostra il focus di NVIDIA sul geometric deep learning—progettare reti neurali che rispettano la geometria dei dati (in questo caso, dati planetari sferici) piuttosto che trattare tutto come un'immagine piatta. Questo è essenziale per evitare distorsioni ai poli e garantire previsioni fisiche stabili su lunghi orizzonti temporali.

6.3 Streaming Efficiente con "QUEEN"

QUEEN: QUantized Efficient ENcoding for Streaming Free-viewpoint Videos 12 affronta il collo di bottiglia della larghezza di banda. Per la teleoperazione dei robot (un passaggio intermedio chiave verso la piena autonomia e cruciale per lo "Strato Apice" della piramide dei dati GR00T), lo streaming video ad alta fedeltà e bassa latenza è essenziale. Questa ricerca abilita una trasmissione dati più efficiente, permettendo agli operatori umani di controllare robot remoti con feedback visivo quasi istantaneo e di alta qualità.

6.4 IA Digitale: Parlare e Sicurezza

Sebbene il focus sia sull'IA Fisica, NVIDIA ha rilasciato strumenti critici di "IA Digitale" che supportano l'ecosistema.

MultiTalker Parakeet: Un modello di riconoscimento vocale capace di gestire conversazioni sovrapposte e veloci. Questo è vitale per i robot di servizio che devono operare in ambienti rumorosi e affollati (bar, ospedali).10

Sortformer: Per la diarizzazione degli altoparlanti in tempo reale (chi sta parlando quando).

Nemotron Content Safety Reasoning: Un modello per applicare politiche di sicurezza personalizzate, assicurando che le risposte del robot o dell'agente non siano dannose o offensive.14

7. Strategia Open Source e Licenze

La decisione di NVIDIA di rendere open source porzioni significative di questo stack è una manovra strategica calcolata per definire gli standard dell'IA Fisica.

7.1 Licenze e Disponibilità

NVIDIA ha adottato una strategia di licenza a più livelli per massimizzare l'adozione proteggendo al contempo gli interessi commerciali.

Risorsa | Tipo di Licenza | Permessi Chiave | Esempio |

Codice Sorgente | Apache 2.0 | Uso commerciale, Modifica, Distribuzione libera | Cosmos Cookbook, AlpaSim, NeMo Gym 25 |

Pesi del Modello | NVIDIA Open Model License | Uso commerciale, Opere derivate, Restrizioni etiche | Cosmos-Diffusion, GR00T N1, Alpamayo-R1 (Pesi) 26 |

Dataset | NVIDIA Open Dataset License | Ricerca e sviluppo, Spesso non commerciale per alcuni sottoinsiemi | Chain of Causation Dataset (Sottoinsieme) 22 |

Analisi della "NVIDIA Open Model License": Questa licenza è permissiva, concedendo una licenza perpetua, mondiale e priva di royalty per l'uso e le opere derivate. Tuttavia, include restrizioni specifiche sull'"Etica dell'IA" (es. nessuna sorveglianza illegale, nessuna raccolta biometrica senza consenso) e conformità legale.26 Conferma esplicitamente che i modelli sono utilizzabili commercialmente 26, un dettaglio cruciale per le startup che costruiscono prodotti su questo stack.

7.2 Il "Pivot" verso l'Apertura

Storicamente nota per il suo "fossato" proprietario CUDA, NVIDIA sta pivotando verso l'apertura nel livello del modello.

Razionale Strategico: Rendendo Alpamayo e GR00T le architetture aperte standard, NVIDIA assicura che la prossima generazione di startup di robotica costruisca sopra lo stack software di NVIDIA (Isaac, Omniverse). Questo inevitabilmente guida la domanda per l'hardware NVIDIA (Orin, Thor, H100) che è ottimizzato per eseguire queste architetture specifiche. È una strategia "Commoditize the Complement": rendendo il software (il modello) abbondante e aperto, aumentano il valore dell'hardware necessario per eseguirlo.

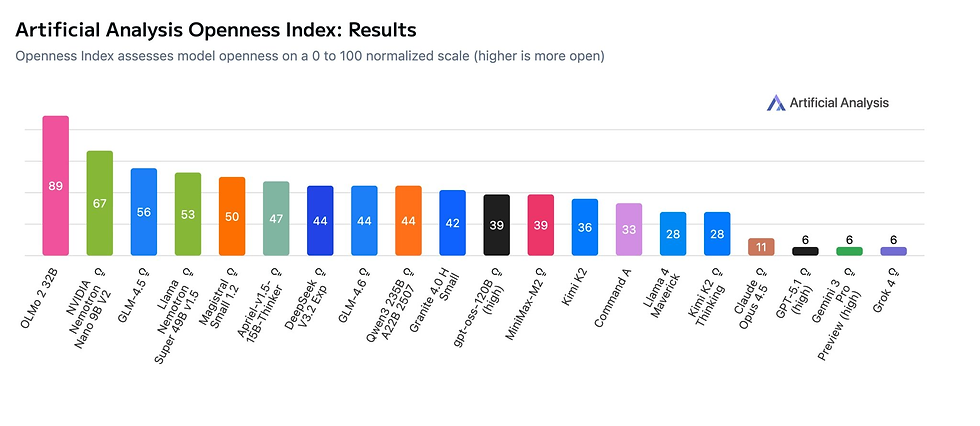

Validazione della Comunità: L'"Artificial Analysis Open Index" ha classificato la famiglia Nemotron di NVIDIA tra le più trasparenti nell'ecosistema, citando le loro chiare licenze e la trasparenza dei dati. Questo segnala un impegno a conquistare la comunità di ricerca open source, che è sempre più scettica verso i laboratori di IA "chiusi".1

Conclusioni

Gli annunci di NVIDIA a NeurIPS rappresentano un momento spartiacque per l'IA Fisica. Fornendo il cervello (GR00T/Alpamayo), la palestra (Omniverse/Isaac) e l'allenatore (Cosmos/NeMo), NVIDIA ha costruito un ecosistema completo che abbassa drasticamente la barriera all'ingresso per l'intelligenza incarnata.

Lo spostamento dall'IA generativa puramente digitale ad agenti fisicamente fondati e capaci di ragionamento rappresenta la prossima frontiera dell'espansione tecnologica. Per ricercatori e professionisti del settore, il rilascio di questi asset open source non è meramente una risorsa—è un mandato per integrare fisica, ragionamento e azione in un paradigma di apprendimento unificato. L'introduzione di architetture come la "Catena di Causalità" in Alpamayo e il sistema cognitivo duale in GR00T suggerisce che il futuro della robotica non risiede in controllori più veloci, ma in robot che "pensano" prima di agire, colmando finalmente il divario tra percezione e cognizione nel mondo reale.

Appendice Tecnica: Specifiche dei Modelli

Famiglia Modello | Variante | Parametri | Funzione Core | Architettura |

Cosmos | Diffusion-Text2World | 7B / 14B | Generazione Video Alta Fedeltà | Diffusion Transformer (DiT), Tokenizzatore Continuo |

Cosmos | Autoregressive-Video2World | 4B / 12B | Previsione Video Lungo Orizzonte | Transformer Autoregressivo, Tokenizzatore Discreto |

Cosmos | Reason1 | 7B | Critica Fisica & Ragionamento | Vision-Language Model (VLM) |

Alpamayo | R1 | Scalabile (0.5B - 7B) | Guida Autonoma (Livello 4) | VLA + Flow-Matching Decoder |

GR00T | N1.5 | 3B (Base) | Controllo Umanoide Generalista | Sistema Duale (VLM + DiT Policy) |

Bibliografia

NVIDIA Opens the Physical-AI Playbook at NeurIPS 2025 : r/AIGuild - Reddit, accesso eseguito il giorno dicembre 2, 2025, https://www.reddit.com/r/AIGuild/comments/1pbxvak/nvidia_opens_the_physicalai_playbook_at_neurips/

At NeurIPS, NVIDIA Advances Open Model Development for Digital and Physical AI, accesso eseguito il giorno dicembre 2, 2025, https://forums.developer.nvidia.com/t/at-neurips-nvidia-advances-open-model-development-for-digital-and-physical-ai/353220

NVIDIA Cosmos for Developers, accesso eseguito il giorno dicembre 2, 2025, https://developer.nvidia.com/cosmos

NVIDIA Cosmos - Physical AI with World Foundation Models, accesso eseguito il giorno dicembre 2, 2025, https://www.nvidia.com/en-us/ai/cosmos/

Nvidia Drops First Open AI Model for Self-Driving Cars, accesso eseguito il giorno dicembre 2, 2025, https://www.techbuzz.ai/articles/nvidia-drops-first-open-ai-model-for-self-driving-cars

Alpamayo-R1: Bridging Reasoning and Action Prediction for Generalizable Autonomous Driving in the Long Tail - arXiv, accesso eseguito il giorno dicembre 2, 2025, https://arxiv.org/html/2511.00088v1

NVIDIA Announces Isaac GR00T N1 — the World's First Open Humanoid Robot Foundation Model — and Simulation Frameworks to Speed Robot Development, accesso eseguito il giorno dicembre 2, 2025, https://nvidianews.nvidia.com/news/nvidia-isaac-gr00t-n1-open-humanoid-robot-foundation-model-simulation-frameworks

GR00T N1: An Open Foundation Model for Generalist Humanoid Robots - arXiv, accesso eseguito il giorno dicembre 2, 2025, https://arxiv.org/abs/2503.14734

NVIDIA Cosmos - GitHub, accesso eseguito il giorno dicembre 2, 2025, https://github.com/nvidia-cosmos

NVIDIA Unveils Alpamayo-R1 and New AI Tools for Speech, Safety, and Autonomous Driving at NeurIPS 2025 - MLQ.ai, accesso eseguito il giorno dicembre 2, 2025, https://mlq.ai/news/nvidia-unveils-alpamayo-r1-and-new-ai-tools-for-speech-safety-and-autonomous-driving-at-neurips-2025/

Machine Learning and the Physical Sciences, NeurIPS 2024, accesso eseguito il giorno dicembre 2, 2025, https://ml4physicalsciences.github.io/2024/

Physical AI - Research at NVIDIA, accesso eseguito il giorno dicembre 2, 2025, https://research.nvidia.com/research-area/physical-ai

NVIDIA and US Manufacturing and Robotics Leaders Drive America's Reindustrialization With Physical AI, accesso eseguito il giorno dicembre 2, 2025, https://nvidianews.nvidia.com/news/nvidia-us-manufacturing-robotics-physical-ai

Nvidia Unveils Advances in Open Digital and Physical AI, accesso eseguito il giorno dicembre 2, 2025, https://www.techrepublic.com/article/news-nvidia-physical-ai/

Accelerating the Next Wave of Physical AI with NVIDIA - YouTube, accesso eseguito il giorno dicembre 2, 2025, https://www.youtube.com/watch?v=QmQJodnpawA

A Deep Dive into NVIDIA Cosmos and Its Capabilities, accesso eseguito il giorno dicembre 2, 2025, https://adasci.org/a-deep-dive-into-nvidia-cosmos-and-its-capabilities/

NVIDIA supercharges the development of humanoid robots with AI | Edison Smart, accesso eseguito il giorno dicembre 2, 2025, https://edisonsmart.com/nvidia-supercharges-the-development-of-humanoid-robots-with-ai/

Cosmos World Foundation Models - NGC Catalog - NVIDIA, accesso eseguito il giorno dicembre 2, 2025, https://catalog.ngc.nvidia.com/orgs/nvidia/teams/cosmos/collections/cosmos

Maximize Robotics Performance by Post-Training NVIDIA Cosmos Reason, accesso eseguito il giorno dicembre 2, 2025, https://developer.nvidia.com/blog/maximize-robotics-performance-by-post-training-nvidia-cosmos-reason/

Nvidia open AI models for autonomous driving, accesso eseguito il giorno dicembre 2, 2025, https://tecknexus.com/nvidia-open-ai-models-for-autonomous-driving/

Alpamayo-R1: Bridging Reasoning and Action Prediction for Generalizable Autonomous Driving in the Long Tail | alphaXiv, accesso eseguito il giorno dicembre 2, 2025, https://www.alphaxiv.org/overview/2511.00088v1

NVIDIA puts autonomous driving at the centre of new open-source AI push at NeurIPS, accesso eseguito il giorno dicembre 2, 2025, https://auto.economictimes.indiatimes.com/news/auto-technology/nvidia-unveils-open-source-ai-revolution-for-autonomous-driving-at-neurips/125714820

NVIDIA Isaac GR00T N1 Foundation Model For Humanoid Robots - Labellerr, accesso eseguito il giorno dicembre 2, 2025, https://www.labellerr.com/blog/nvidia-groot-n1/

NVIDIA Isaac GR00T N1.5 - A Foundation Model for Generalist Robots. - GitHub, accesso eseguito il giorno dicembre 2, 2025, https://github.com/NVIDIA/Isaac-GR00T

cosmos-reason1/LICENSE at main - GitHub, accesso eseguito il giorno dicembre 2, 2025, https://github.com/nvidia-cosmos/cosmos-reason1/blob/main/LICENSE

NVIDIA Open Model License Agreement, accesso eseguito il giorno dicembre 2, 2025, https://developer.download.nvidia.com/licenses/nvidia-open-model-license-agreement-june-2024.pdf

Commenti